2026年3月24日、英Armがサンフランシスコで発表した「AGI CPU」は、同社35年の歴史における最大の戦略転換を具現化した製品である。IPライセンスモデルから自社シリコン販売へ——この転換は、データセンターCPU市場の構造そのものを書き換える可能性を持つ。136コアのNeoverse V3アーキテクチャ、TSMC 3nm N3Pプロセス、300WのTDP。Meta、OpenAI、Cloudflare、SAPが初期顧客として名を連ね、2031年までに150億ドルの収益を見込む。Citiはこれを「同社史上最も重要な転換」と評した。本記事では、AI推論経済の構造転換の文脈の中で、このチップが半導体市場の権力構造にもたらすインパクトを経済の視点から分析する。

35年のIPモデルからの離脱 ── Armのビジネスモデル経済学

Armは1990年の創業以来、一貫してIPライセンスモデルを事業の基盤としてきた。チップを設計するが製造はしない。ライセンス料とロイヤリティ収入で利益を得る。このモデルはスマートフォン時代に圧倒的な成功を収め、世界のモバイルプロセッサの99%以上がArm設計に基づいている。しかしこのモデルには構造的な収益上限がある。1チップあたりの収入がライセンス料とロイヤリティに限定されるため、チップ単価の上昇分を十分に取り込めないのである。

AGI CPUの発表は、この構造的制約からの脱却を意味する。自社シリコンを直接販売することで、ロイヤリティに加えてチップ1個あたりの直接マージンを上乗せできる。Arm CEO レネ・ハースは、AGI CPU単体で2031年に150億ドルの年間収益を見込むと発表した。これは同社の2025年度総収益(約39億ドル)の約4倍に相当する。

注目すべきは、この転換がライセンスビジネスを代替するものではなく、上乗せする構造だという点である。NVIDIA、Qualcomm、Apple、Amazon、Google、Microsoftといった既存ライセンシーは引き続きArmのIP設計に基づく独自チップを製造する。AGI CPUは、自社でカスタムチップを設計するリソースを持たない企業群に対して、「Arm純正」のデータセンターCPUを直接提供するポジションを狙っている。筆者は10年以上にわたり技術事業の経営に携わってきたが、ビジネスモデルの転換で最も重要なのは既存収益源を毀損しない設計であり、Armのこの戦略は教科書的に正しいアプローチと評価できる。

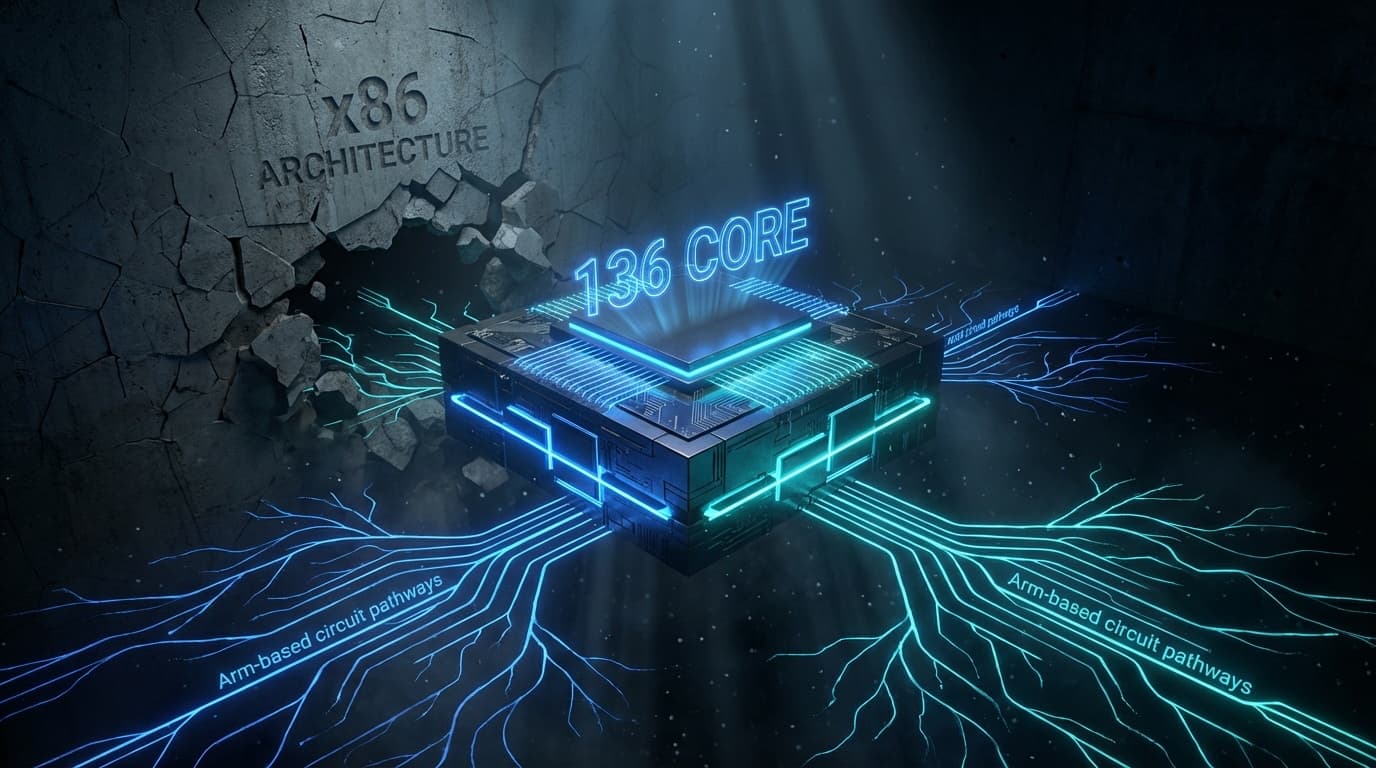

136コアの設計思想 ── エージェンティックAIが求めるCPUアーキテクチャ

AGI CPUの技術仕様は、従来のサーバーCPUとは明確に異なる設計思想に基づいている。136基のNeoverse V3コアをTSMC 3nm N3Pプロセスのデュアルダイ設計で搭載し、各コアに2MBのL2キャッシュ、チップ全体で128MBの共有システムレベルキャッシュを備える。クロック速度はベース3.2GHz、ブースト時3.7GHz。メモリは12チャネルのDDR5(最大8800MT/s、帯域幅825GB/s)、I/Oは96レーンのPCIe 6.0とCXL 3.0をサポートする。TDPは300Wである。

この設計で特に注目すべきは、「削ったもの」の方である。Arm Cloud AIビジネスユニットのEVP モハメド・アワドは「100%利用されないものは意図的に搭載しなかった」と語っている。具体的には、同時マルチスレッディング(SMT)を排除し、SIMDの拡張を最小限に抑えた。これはAIエージェントのワークロード特性——大量のデータ移動とオーケストレーション処理が中心で、浮動小数点演算の比重が低い——に最適化した結果である。

従来のx86サーバーCPUは、汎用性を重視してSMT、AVX-512、各種アクセラレータを搭載してきた。しかしエージェンティックAIのワークロードでは、これらの機能の多くがダイ面積と消費電力を浪費するだけになる。AGI CPUは「コード実行、タスク自動化、マルチエージェント協調」というエージェンティックAI固有の要件に特化することで、同じ電力枠でより多くのコアを詰め込む戦略を取った。

この設計思想が実現するラック密度は圧倒的である。空冷ラック(36kW)で30ブレード・8,160コア、液冷ラック(200kW)では42台の8ノードサーバーで45,696コアを搭載可能とされる。Armはx86プラットフォーム比で「ラックあたり2倍以上の性能」を主張しており、ギガワットあたり最大100億ドルのCAPEX削減が可能としている。KubeCon EU 2026で議論されたGPU運用効率化の流れと合わせて考えると、AI推論インフラのコスト構造は2026年後半から根本的に変化する可能性が高い。

Metaの戦略的関与とハイパースケーラー経済学

AGI CPUの開発において、Metaはリードパートナーとして深く関与している。Metaのインフラ統括責任者サントシュ・ジャナルダンは、両社が共同でチップを開発し「複数世代にわたるロードマップにコミットしている」と明言した。Metaは自社開発のAIアクセラレータMTIAと並行してAGI CPUを配備する計画である。

Metaの関与が示す経済的含意は大きい。同社のAIインフラ投資は2026年だけで推定500億ドルを超えるとされ、CPUコストはその相当部分を占める。従来のx86サーバーからArm AGI CPUへの移行が実現すれば、電力効率の改善(x86比で推定1.5〜2倍の性能/ワット)によるランニングコスト削減に加え、ラック密度向上によるデータセンター物理空間の効率化が見込める。

OpenAIの産業コンピュート責任者サチン・カッティは、AGI CPUが「大規模AIワークロードを協調制御するオーケストレーション層を強化する」と述べた。ここで重要なのは、AGI CPUがGPUを置き換えるのではなく、GPUと協調するCPU層の効率化を狙っている点である。AIエージェントが複数のツールを並行呼び出しし、外部APIと通信し、中間結果を集約する処理は、GPU向きではなくCPU向きのワークロードである。エージェンティックAIの普及に伴い、この「CPU層のボトルネック」が顕在化しつつあることが、AGI CPUの市場機会の根拠となっている。

Cerebras、Cloudflare、F5、SAP、SK Telecom、Rebellions、Positronといった多様な顧客層の確保も注目に値する。AIスタートアップ(Cerebras、Positron)、CDN/エッジ(Cloudflare、F5)、エンタープライズ(SAP)、通信(SK Telecom)、AIアクセラレータ(Rebellions)と、用途が広範にわたっている。OEMパートナーとしてはLenovo、ASRock Rack、QCT、Supermicroが19インチラックシステムを開発中である。

x86独占崩壊の構造分析 ── Intel・AMDへのインパクト

データセンターCPU市場におけるx86の支配は、すでに侵食が進行している。2025年時点でx86のシェアは約54%まで低下し、Arm系チップが約15%を占める。しかしハイパースケーラーに限定すると、2025年に出荷されたコンピュートの約50%がすでにArm系であるとの分析もある。AWS Graviton、Google Axion、Microsoft Cobalt、NVIDIA Grace——各社が独自のArmベースCPUを展開し、x86からの移行を加速させている。

この文脈でAGI CPUが持つ意味は、「Arm純正品」の登場によるエコシステムの完成である。これまでArmベースのデータセンターCPUを使うには、自社で設計チームを抱えるか、NVIDIAやAmpere等の特定ベンダーに依存する必要があった。AGI CPUは、Armアーキテクチャの本家が直接シリコンを提供することで、中堅クラウドプロバイダーやオンプレミス事業者にもArmへの移行パスを開く。

Intelの反応は興味深い。データセンターグループ責任者ケヴォーク・ケチチアンは、エージェンティックAIに特化したCPUアーキテクチャの必要性に懐疑的な姿勢を示した。同氏はIntelのClearwater Forest(288コア、SMTなし、最小限のSIMD)がAGI CPUと類似のスペックプロファイルを持つと指摘し、「(Armが)選択肢があればSMTを搭載していたはず」と技術的制約を示唆した。しかし、Intel自身がXeon 6+のエージェンティックAIユースケースでの需要が限定的であることを認めており、この市場での存在感は薄い。

Intelは18Aプロセスと先端パッケージングによるファウンドリ事業への転換を模索しているが、データセンターCPU市場での攻勢という観点では、Armの動きに対する直接的な回答を持ち合わせていない。AMDはEPYC 9005シリーズで依然として強い競争力を持つが、AGI CPUの300W TDPに対してEPYCの上位モデルは500W前後であり、電力効率で不利な構造が生じている。

データセンターCPU市場は2029年に766億ドル規模に達し、年率34.9%で成長するとの予測がある。この成長の大部分がAI推論関連であることを考えると、AGI CPUのようなAI推論特化型アーキテクチャが市場シェアを急速に拡大する余地は大きい。調査会社の分析では、2029年にはカスタムプロセッサベースのAIサーバーの90%がArmチップを搭載するとの予測もある。

エネルギー経済性と電力制約 ── ギガワットあたりの資本効率

AGI CPUの経済的優位性を最も端的に示すのが、電力あたりの計算密度である。300W TDPで136コアという仕様は、コアあたり約2.2Wを意味する。対するIntel Xeon 6の上位モデルは350〜500W帯で128〜288コア、AMD EPYCは400〜500W帯で128〜192コア(SMT込み)である。実効的なAIエージェント処理能力で比較した場合、Armは「ラックあたり2倍以上のスループット」を主張している。

この電力効率の差は、データセンター事業者にとって直接的なコスト削減に変換される。現在のAIデータセンター建設コストはギガワットあたり100〜150億ドルとされる。AGI CPUの密度優位がArmの主張通りであれば、同じ計算量を半分の電力で処理できることになり、ギガワットあたり数十億ドル規模のCAPEX削減が理論上可能となる。Google CloudやMicrosoft Azureの内部評価では、Armベースプロセッサへの移行で「x86比で30〜60%の性能・消費電力改善」が報告されている。

電力制約は2026年のデータセンター産業における最大のボトルネックである。米国だけでもAIデータセンターの電力需要は2030年までに50〜80GWに達するとの予測があり、電力供給が建設計画のペースを制約している。このような環境では、同じ電力枠でより多くの計算を実行できるアーキテクチャが、単なる技術的優位を超えて戦略的必然性を持つ。筆者がAI教育事業やプロダクト開発で複数のクラウドインフラを運用してきた経験から言えることは、インフラのコスト構造は技術選定を根本から規定するということである。電力効率の差がこの規模に達すると、それは技術的嗜好の問題ではなく、事業の損益に直結する経営判断となる。

2026年後半以降の市場シナリオ ── 構造転換の行方

AGI CPUの量産出荷は2026年後半に開始され、収益への本格的な貢献は2028年以降と見込まれている。この時間軸を踏まえ、データセンターCPU市場の構造転換について3つのシナリオを提示する。

シナリオ1: エージェンティックAI市場の急拡大(確率40%)

OpenAIのGPT-5系列やAnthropicのClaudeに代表されるAIエージェントフレームワークが2027年までに企業ITインフラに広く浸透し、CPU層のオーケストレーション需要が爆発的に増加する。この場合、AGI CPUは150億ドルの収益目標を前倒しで達成する可能性がある。x86のデータセンターシェアは2029年に40%を下回り、Armが25〜30%を占める。

シナリオ2: 段階的移行(確率45%)

エージェンティックAIの普及は進むものの、既存のx86インフラとの互換性要件やソフトウェアエコシステムの成熟度が移行速度を制約する。AGI CPUは2031年に100〜120億ドルの収益を達成し、目標の150億ドルには1〜2年の遅延が生じる。x86のシェアは2029年に45%程度を維持するが、新規導入の過半数がArm系となる。

シナリオ3: x86の反撃(確率15%)

IntelのClearwater ForestやAMDの次世代EPYCが電力効率で大幅な改善を達成し、x86のエコシステム優位が移行コストを上回る。AGI CPUの採用は大手ハイパースケーラーに限定され、収益は2031年に50〜80億ドル程度に留まる。

いずれのシナリオにおいても、x86の独占的地位が回復する可能性は低い。問題は「どの程度のスピードで構造転換が進むか」であり、その変数はAIエージェント技術の成熟速度と電力制約の深刻度に大きく依存する。

日本市場への示唆 ── 半導体産業政策とAIインフラ投資

日本の半導体産業政策にとって、AGI CPUの登場は複合的な示唆を持つ。TSMCの熊本工場(JASM)はN28/N16/N7プロセスを対象としており、AGI CPUが採用するN3Pとは世代差がある。ラピダスが2027年の量産を目指す2nmプロセスが実現すれば、次世代AGI CPUの製造候補となる可能性はあるが、現時点では推測の域を出ない。

より直接的な影響は、日本企業のAIインフラ投資判断に及ぶ。経済産業省が推進するAIデータセンター整備計画において、CPUの選定はインフラ全体の電力効率と運用コストを左右する。AGI CPUの電力効率がArmの主張通りであれば、日本のAIインフラ整備においてもArm系プラットフォームの採用が合理的選択となるケースが増える。特にSK Telecomが初期顧客に含まれていることは、アジア太平洋地域での通信事業者向けAIインフラにおけるArm浸透の先行指標となり得る。

LLMを活用したシンクタンクメディアの開発・運営を通じて実感するのは、AI推論のコスト構造が事業の持続可能性を直接左右するという現実である。推論コストが半減すれば、それだけで提供可能なサービスの幅と深度が変わる。AGI CPUがもたらす電力効率の改善は、ハイパースケーラーだけの話ではなく、AIを事業基盤に据えるすべての企業にとっての構造的変数である。

FAQ

Arm AGI CPUとは何か?従来のArmチップと何が違う?

AGI CPUは、Armが35年の歴史で初めて自社ブランドで製造・販売するデータセンター向けCPUである。従来のArmビジネスはIP設計のライセンスとロイヤリティ収入が中心だったが、AGI CPUでは完成したシリコンを直接販売する。136コアのNeoverse V3アーキテクチャ、TSMC 3nmプロセス、300W TDPという仕様で、AIエージェントのオーケストレーション処理に特化した設計となっている。

AGI CPUはGPUを置き換えるのか?

置き換えるものではない。AGI CPUはAIモデルの学習や大規模推論そのものではなく、AIエージェントのオーケストレーション——タスク分配、外部API呼び出し、中間結果の集約——を担うCPU層の効率化を狙っている。GPUやAIアクセラレータと協調して動作する位置づけであり、Metaも自社のMTIAアクセラレータとの併用を計画している。

x86サーバーからの移行コストはどの程度か?

ソフトウェアの移植コストはワークロードによって大きく異なる。クラウドネイティブなコンテナ化されたワークロードであれば移行は比較的容易だが、x86固有の命令セット(AVX-512等)に依存するアプリケーションは再コンパイルや最適化が必要となる。AWS GravitonやGoogle Axionでの先行事例から、一般的なWebサービスやマイクロサービスアーキテクチャでは移行障壁は低い傾向にある。

150億ドルの収益目標は現実的か?

データセンターCPU市場は2029年に766億ドル規模に成長すると予測されている。AGI CPUの150億ドル(2031年)はこの市場の約15〜20%のシェアに相当する。Meta、OpenAI等の大口顧客を確保していること、電力効率での構造的優位があることを考慮すると達成可能な範囲であるが、ソフトウェアエコシステムの成熟と量産体制の確立が前提条件となる。

日本企業のAIインフラ戦略にはどう影響する?

電力コストが高い日本市場では、AGI CPUの電力効率優位がより大きなコスト削減効果をもたらす。経済産業省のAIデータセンター整備計画においても、Arm系プラットフォームの検討が合理的となるケースが増えるだろう。ただし、既存のx86ベースのエンタープライズシステムとの互換性や運用ノウハウの蓄積を考慮した段階的な移行が現実的である。

参考文献

- Arm expands compute platform to silicon products in historic company first — Arm Newsroom, 2026年3月24日

- Arm releases first in-house chip, with Meta as debut customer — CNBC, 2026年3月24日

- Arm rolls its own 136-core AGI CPU to chase AI hype train — The Register, 2026年3月24日

- Arm says AI agents need a new CPU. Intel doesn't buy it — The Register, 2026年3月31日

- Arm moves beyond IP with AGI CPU silicon — Tom's Hardware, 2026年3月

- Arm AGI CPU Launched Establishing Arm as a Silicon Provider — ServeTheHome, 2026年3月

- CPUs are Back: The Datacenter CPU Landscape in 2026 — SemiAnalysis, 2026年

- Arm's $15 Billion CPU Opportunity Hinges on Agentic Data Center Design — Futurum Group, 2026年3月